Velké jazykové modely (LLM) jako Google Bard hrají významnou roli při předávání informací a podpoře uživatelů v různých oblastech. I když tyto technologie poskytují impozantní výsledky, mají také své hranice a výzvy. V tomto návodu se zaměříš na důkladné zkoumání limitací Google Bard. Cílem je získat kritické pochopení fungování těchto modelů, abys mohl/a lépe posoudit poskytnuté informace a v případě potřeby je kritizovat.

Nejdůležitější zjištění

- Google Bard a podobné modely nejsou dokonalé a obsahují chyby.

- Výstupy mohou být obsahově nesprávné, i když působí přesvědčivě.

- Musíš být vždy kritický/á a ověřovat informace, než je rozšíříš.

Krok za krokem

Porozumění chybovosti

Je důležité si uvědomit, že Google Bard, stejně jako mnoho jiných velkých jazykových modelů, není bezchybný. Pravděpodobně jsi si už všiml/a, že kvalita výstupů kolísá. Pokud máš pocit, že výsledky nejsou uspokojivé, dovol si být kritický/á.

Přijetí chybných výstupů

Výsledky z Google Bard mohou často být neúplné nebo dokonce zcela chybné. S tímto se pravděpodobně již setkal/a ve svých vlastních zkušenostech v tomto kurzu. Je velmi důležité porozumět tomu, že výstup z Bard není vždy spolehlivý.

Ověřování šíření informací

Pokud máš informace pocházející z Google Bard, měl/a bys je vždy ověřit před šířením. Neseme odpovědnost za to, aby informace byly správné. Pokud máš pochybnosti, konzultuj další zdroje předtím, než něco sdílíš.

Analýza příkladů chyb

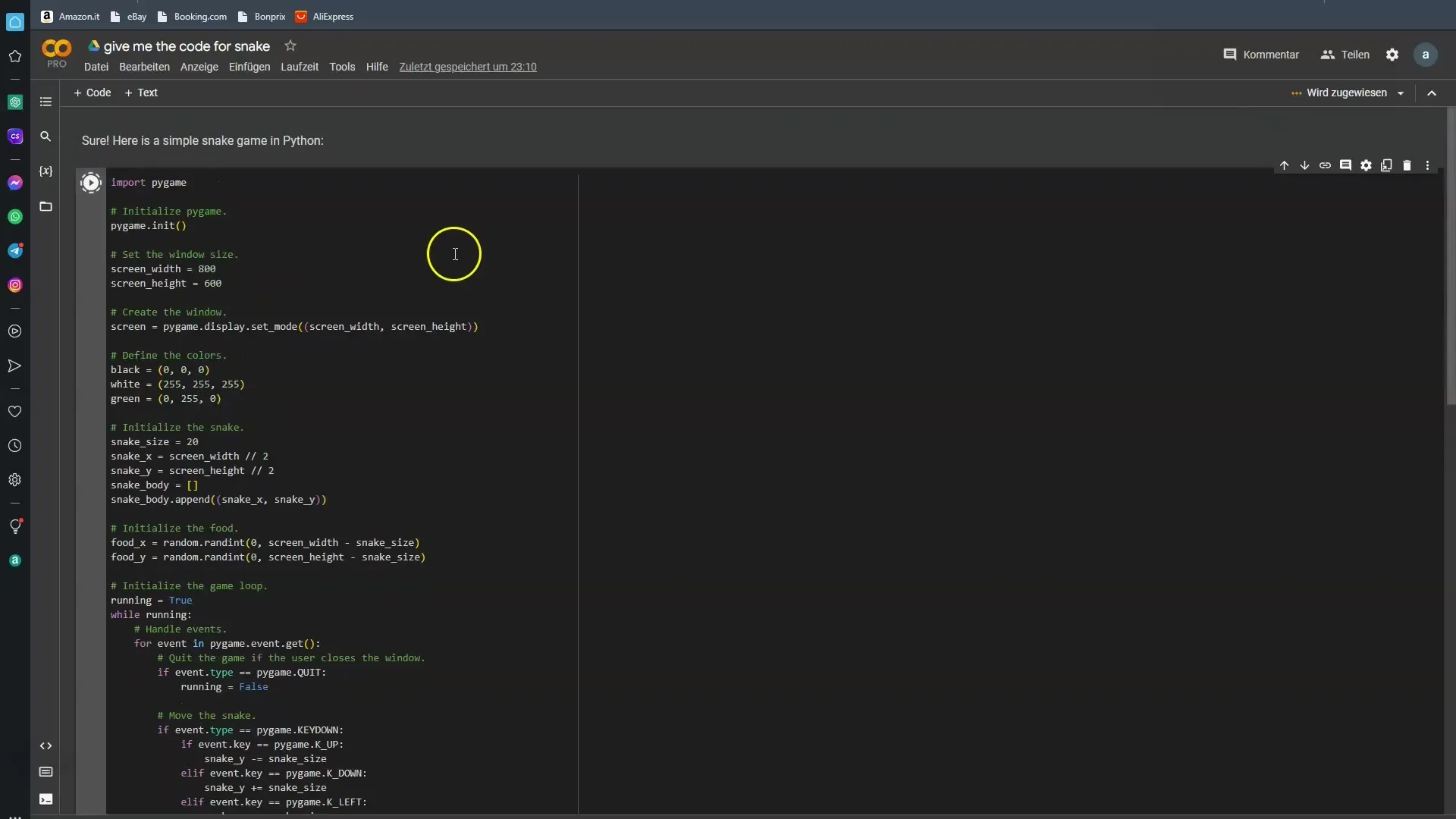

Aby sis uvědomil/a chybovost Google Bard, je užitečné se podívat na konkrétní příklady. Požádal/a jsem Barda o kód programu pro jednoduchou hru Snake. Ve většině případů Bard selhal. Podívejme se, jestli máme tentokrát více štěstí.

Praktické použití informací

Zvláště když máš technické dotazy, měl/a bys si uvědomit, že odpovědi z Google Barda někdy neodpovídají tvým očekáváním. Je v pořádku testovat je za různých podmínek, abys ověřil/a, zda dostaneš požadovaný výstup.

Nezbytnost kritického myšlení

Vždy, když pracuješ s výsledky AI, je nutné přepnout do režimu kritického myšlení. Google Bard ti může představit mnoho věcí, ale ne všechny jsou správné. Model je cvičený k učení se z mnoha dat, avšak tato data nejsou vždy bezchybná.

Budoucí vylepšení v dohledu

Očekává se, že budou modely v budoucnosti nadále zlepšovány. Chybovost by s pokrokem technologie měla snižovat. Avšak je důležité uznat současné omezení, abys je mohl/a zohlednit při jejich využití.

Shrnutí

Svět asistence a informací podporovaných AI je vzrušující a plný možností, ale nese také rizika. Google Bard a podobné modely jsou krokem do budoucnosti, ale přinášejí také omezení. Je klíčové, abys tyto limity rozpoznal/a a naučil/a se informace posuzovat s kritickým pohledem.

Často kladené otázky

Jaké jsou hlavní chyby Google Barda?Hlavní chyby Google Barda spočívají v nepřesnosti poskytnutých informací.

Proč bych měl/a ověřovat informace poskytnuté Bardem?Informace poskytnuté Bardem mohou být chybné a ne vždy spolehlivé.

Mohu použít Google Barda na technické dotazy?Ano, ale měl/a bys kriticky přezkoumat odpovědi a v případě potřeby konzultovat jiné zdroje.

Kdo trénoval Google Barda?Google Bard a podobné modely jsou trénovány lidmi, což může vést k lidským chybám.

Stane se Google Bard v budoucnosti lepším?Ano, očekává se, že budoucí verze budou méně náchylné k chybám.