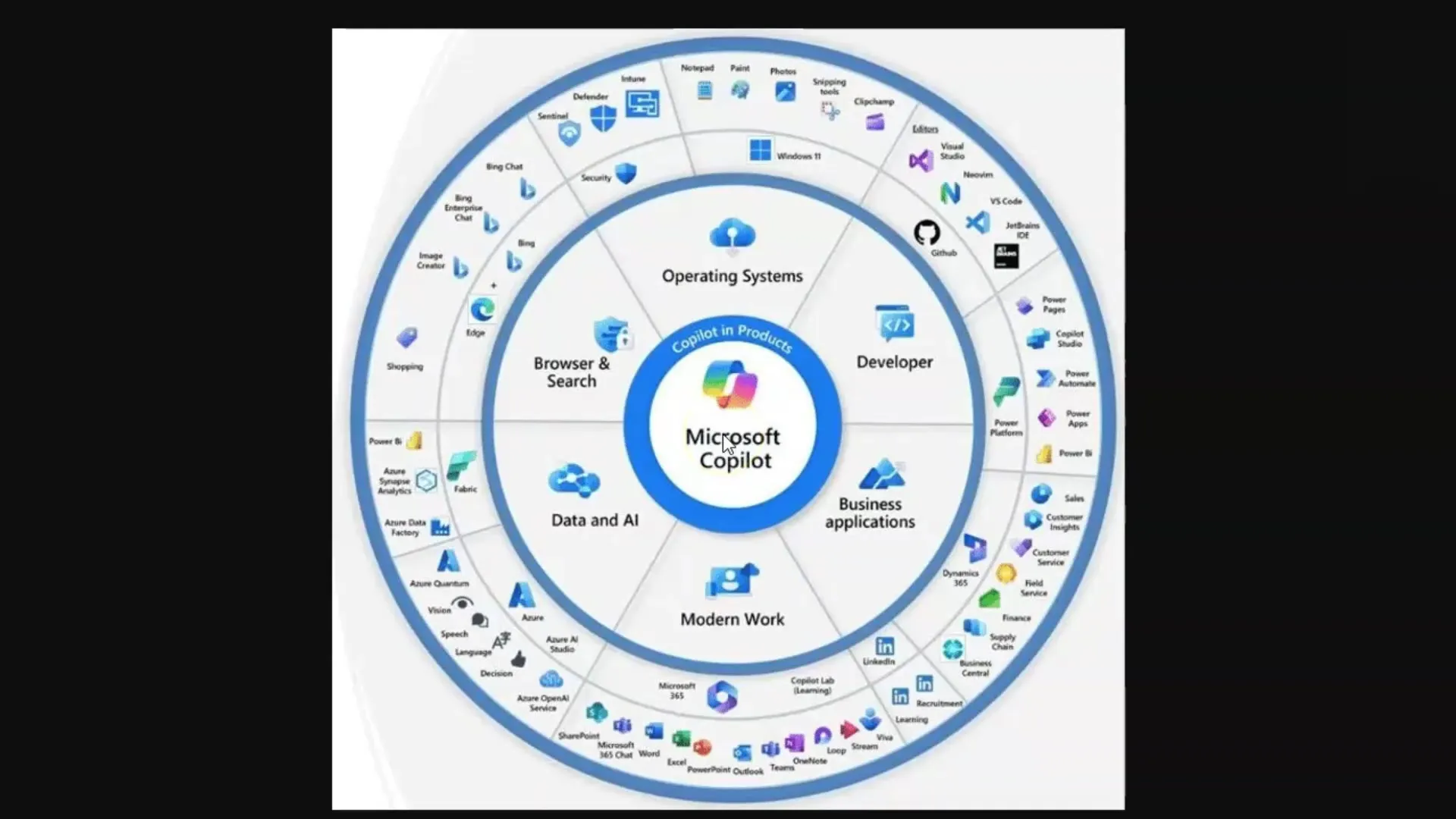

In diesem Tutorial wirst du lernen, wie Large Language Models (LLMs) und Diffusionsmodelle funktionieren, insbesondere im Zusammenhang mit Microsoft Copilot. Diese Technologien sind entscheidend für die Generation von Texten und Bildern, die in verschiedenen Anwendungen von künstlicher Intelligenz verwendet werden. Um das volle Potenzial dieser Tools auszuschöpfen, ist es wichtig, die grundlegenden Konzepte zu verstehen, die hinter ihnen stehen.

Wichtigste Erkenntnisse

- Large Language Models (LLMs) generieren Texte basierend auf einem großen Korpus von trainierten Daten.

- Diffusionsmodelle erzeugen Bilder und lernen durch die Verarbeitung von Bild-Text-Paaren.

- Die Begrenzung durch Token-Limitierungen ist ein zentrales Konzept bei der Arbeit mit LLMs.

- Effektives Prompt Engineering ist wichtig, um qualitativ hochwertige Antworten von LLMs zu erhalten.

Schritt-für-Schritt-Anleitung

Schritt 1: Grundverständnis von Large Language Models (LLMs)

Um LLMs zu verstehen, musst du wissen, dass es sich um Sprachmodelle handelt, die auf einer riesigen Menge an Texten trainiert wurden. Diese Modelle sind in der Lage, Fragen zu beantworten, indem sie relevante Informationen aus dem gelernten Text extrahieren. Denke daran, dass du in diesem Kontext der Computer bist, der Informationen findet.

Du stellst eine Frage und das Modell sucht nach den passenden Wörtern in seinem "Gedächtnis", das aus den trainierten Daten besteht. Hierbei ist es wichtig, dass du die richtigen Fragen stellst – ein Konzept, das als "Prompt Engineering" bekannt ist.

Schritt 2: Token und ihre Bedeutung

Ein LLM verarbeitet Text durch das Zerlegen von Wörtern in "Token", also in kleinere Einheiten, die Wörter repräsentieren. Zum Beispiel entspricht ein Token im Durchschnitt etwa vier Buchstaben oder einem dreiviertel Wort. Diese Token sind wichtig, da jedes Model eine bestimmte Anzahl an Tokens verarbeiten kann, was als Token-Limit bezeichnet wird.

Die Token-Limits können variieren: Das Standardmodell GPT-3.5 hat beispielsweise ein Limit von 4.000 Tokens, während das aktuelle Modell GPT-4 sogar mit bis zu 128.000 Tokens arbeitet. Es ist wichtig zu beachten, dass diese Limitationen die Konversation und die Fähigkeit, Informationen zu speichern und abzurufen, beeinflussen können.

Schritt 3: Umgang mit Token-Limitierungen

Da jedes Sprachmodell ein Token-Limit hat, ist es entscheidend, dies zu berücksichtigen, wenn du mit LLMs arbeitest. Wenn das Limit überschritten wird, kann das Modell "vergessen", worüber ihr gesprochen habt. Hierbei ist es hilfreich, Zusammenfassungen zu erstellen oder große Texte in Stichpunkte zu unterteilen, um die relevantesten Informationen zu erfassen.

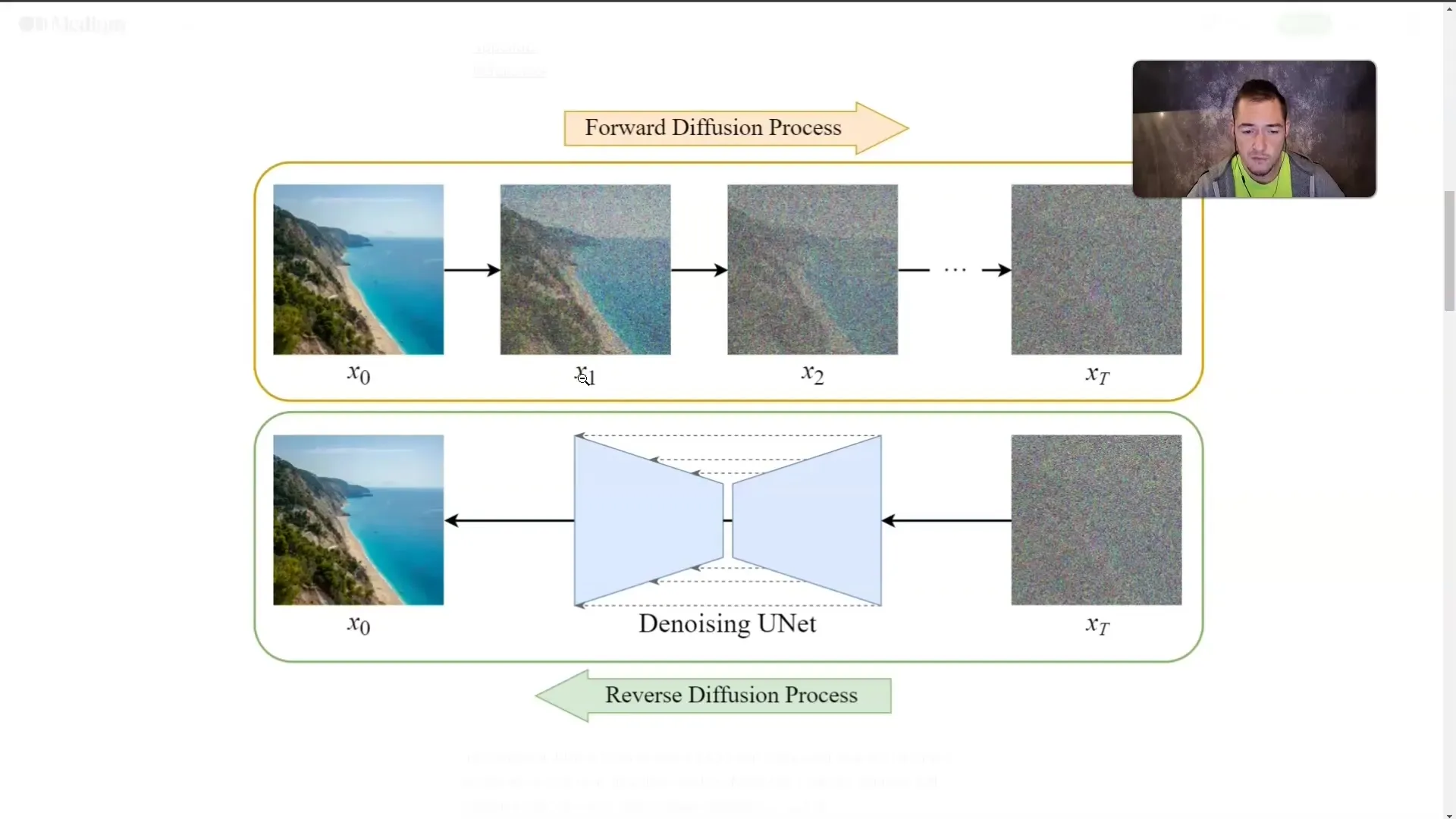

Schritt 4: Verständnis von Diffusionsmodellen

Neben den LLMs sind auch Diffusionsmodelle von großer Bedeutung. Diese Modelle erzeugen Bilder, indem sie mit Bild-Text-Paaren trainiert werden. Dabei wird ein Bild schrittweise mit "Nebel" überlagert, bis es nicht mehr sichtbar ist. Während des Trainings lernt das Modell, wie die Bilder aussehen, selbst wenn es sie nicht mehr direkt sieht.

Diese Technik erlaubt es dem Modell, aus einem beschreibenden Text ein Bild zu generieren. Je detaillierter du den gewünschten Inhalt beschreibst, desto präziser kann das Modell das Bild erzeugen.

Schritt 5: Anwendung der Konzepte

Nachdem du die Funktionsweise von LLMs und Diffusionsmodellen verstanden hast, ist es wichtig, diese Kenntnisse praktisch anzuwenden. Bei der Nutzung von Microsoft Copilot solltest du immer darauf achten, präzise und relevante Fragen zu stellen, um die besten Ergebnisse zu erzielen.

Egal, ob du Texte generierst oder Bilder erstellst, die Qualität deiner Eingaben wird direkt die Qualität der Outputs beeinflussen.

Zusammenfassung

In diesem Tutorial hast du die grundlegenden Konzepte von LLMs und Diffusionsmodellen kennengelernt. Du weißt jetzt, wie diese Technologien funktionieren, welche Rolle Tokens spielen und wie wichtig das Prompt Engineering für die Qualität der Ergebnisse ist. Das Verständnis dieser Konzepte ist entscheidend, um mit Microsoft Copilot und ähnlichen KI-Anwendungen effektiv zu arbeiten.

Häufig gestellte Fragen

Was sind Large Language Models?LLMs sind Sprachmodelle, die an großen Textmengen trainiert werden, um Texte zu generieren und Fragen zu beantworten.

Was sind Diffusionsmodelle?Diffusionsmodelle sind KI-Modelle, die Bilder generieren, indem sie diese schrittweise "nebeln" und lernen, was hinter den Nebeln verborgen ist.

Warum sind Tokens wichtig?Tokens sind die kleinsten Einheiten der Wörter, die von LLMs verarbeitet werden, und jedes Modell hat ein Limit, wie viele Tokens es gleichzeitig verarbeiten kann.

Wie kann ich das Token Limit umgehen?Einige Methoden umfassen das Erstellen von Zusammenfassungen oder das Aufteilen von Texten in Stichpunkte.

Was ist Prompt Engineering?Prompt Engineering bezieht sich auf die Kunst, effektive und präzise Fragen zu stellen, um qualitativ hochwertige Antworten von LLMs zu erhalten.