Modele językowe na dużą skalę (LLM) takie jak Google Bard odgrywają istotną rolę w dostarczaniu informacji i wspieraniu użytkowników w różnych dziedzinach. Pomimo tego, że te technologie dostarczają imponujące wyniki, mają również swoje granice i wyzwania. W tym poradniku przyjrzysz się bliżej ograniczeniom Google Barda. Celem jest rozwinięcie krytycznego zrozumienia sposobu działania takich modeli, abyś mógł lepiej oceniać dostarczone informacje i w razie potrzeby je kwestionować.

Najważniejsze ustalenia

- Google Bard i podobne modele nie są doskonałe i mają błędy.

- Wygenerowane wyniki mogą być merytorycznie nieprawidłowe, pomimo że wyglądają przekonująco.

- Zawsze musisz zachować krytycyzm i zweryfikować informacje, zanim je rozpowszechnisz.

Krok po kroku

Zrozumienie wskaźnika błędów

Ważne jest, abyś zdawał sobie sprawę, że Google Bard, podobnie jak wiele innych dużych modeli językowych, nie jest wolny od błędów. Prawdopodobnie zauważyłeś już, że jakość generowanych wyników jest zróżnicowana. Jeśli masz wrażenie, że wyniki nie są zadowalające, pozwól sobie być krytycznym.

Uznawanie błędnych wyników

Często wyniki generowane przez Google Barda mogą być niepoprawne lub wręcz całkowicie fałszywe. Być może już się z tym spotkałeś, pracując w ramach tego kursu. Istotne jest, abyś zrozumiał, że wyniki Bardoa nie zawsze są wiarygodne.

Kwestionowanie verbreitung von Informationen

Jeśli masz informacje pochodzące od Google Barda, zawsze powinieneś je zweryfikować przed ich rozpowszechnieniem. Ponosisz odpowiedzialność za to, aby informacje były poprawne. Jeśli masz wątpliwości, skonsultuj się dodatkowo z innymi źródłami przed udostępnieniem informacji.

Analiza przykładów błędów

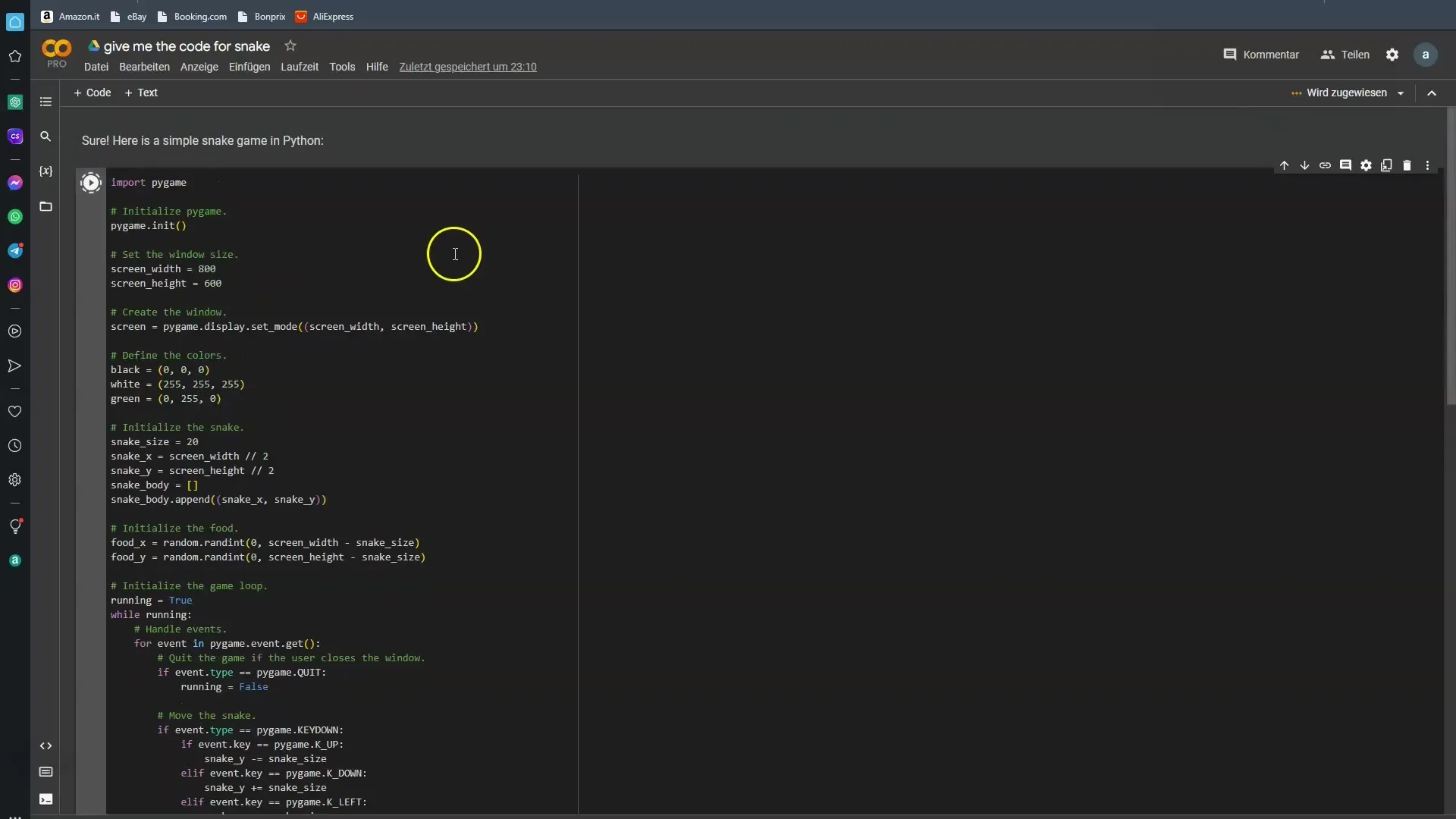

Aby zobaczyć błędy Google Barda, pomocne może być przyjrzenie się konkretnym przykładom. Zapytałem Barda o kod programu do prosty Snake-Spiel. W większości przypadków Bard sobie z tym nie poradził. Zobaczmy, czy tym razem mamy więcej szczęścia.

Stosowanie praktyczne informacji

Szczególnie w przypadku pytań technicznych powinieneś mieć świadomość, że odpowiedzi od Google Barda czasem nie spełniają Twoich oczekiwań. Dobrze jest przetestować to w różnych warunkach, aby sprawdzić, czy otrzymasz pożądany wynik.

Potrzeba myślenia krytycznego

Zawsze, gdy pracujesz z wynikami sztucznej inteligencji, konieczne jest przejście w krytyczny tryb myślenia. Google Bard może zaprezentować Ci wiele rzeczy, ale nie wszystko jest poprawne. Model ten jest szkolony na bazie wielu danych, ale te dane nie zawsze są wolne od błędów.

Oczekiwane usprawnienia w przyszłości

Przewidywane jest, że modele będą dalej udoskonalane w przyszłości. Oczekuje się, że w miarę postępu technicznego podatność na błędy będzie zmniejszać się. Niemniej jednak warto również doceniać obecne ograniczenia, abyś mógł uwzględnić je podczas korzystania z systemu.

Podsumowanie

Świat wsparcia i informacji oparty na sztucznej inteligencji jest ekscytujący i pełen możliwości, ale niesie również pewne ryzyka. Google Bard i podobne modele stanowią krok w przyszłość, ale niosą ze sobą pewne ograniczenia. Ważne jest, abyś rozpoznał te ograniczenia i nauczył się oceniać informacje z krytycznego punktu widzenia.

Najczęstsze pytania

Jakie są główne błędy Google Barda?Główne błędy Google Barda wynikają z niedokładności dostarczonych informacji.

Dlaczego warto zweryfikować dostarczone informacje przez Barda?Dostarczone przez Barda informacje mogą być błędne i nie zawsze wiarygodne.

Czy mogę korzystać z Google Barda do pytań technicznych?Tak, jednak odpowiedzi od Barda warto krytycznie zweryfikować i w razie potrzeby skonsultować się z innymi źródłami.

Kto szkolił Google Barda?Google Bard i podobne modele są szkolen przez ludzi, co może prowadzić do ludzkich błędów.

Czy Google Bard będzie się poprawiał w przyszłości?Tak, spodziewa się, że przyszłe wersje będą mniej podatne na błędy.