Mari modele de limbă (LLM) precum Google Bard joacă un rol semnificativ în furnizarea informațiilor și în sprijinirea utilizatorilor în diferite domenii. În timp ce aceste tehnologii oferă rezultate impresionante, ele au și limitele și provocările lor. În acest tutorial vei examina mai atent limitările lui Google Bard. Scopul este să dezvolți o înțelegere critică a modului în care funcționează astfel de modele, astfel încât să poți evalua mai bine informațiile furnizate și, dacă este necesar, să le pui sub semnul întrebării.

Concluzii cheie

- Google Bard și modelele similare nu sunt perfecte și au erori.

- Ieșirile pot fi incorecte din punct de vedere conținut, chiar dacă par convingătoare.

- Trebuie să fii întotdeauna critic și să verifici informațiile înainte de a le distribui.

Ghid pas cu pas

Înțelegerea ratei de eroare

Este important să-ți dai seama că Google Bard, la fel ca multe alte mari modele de limbaj, nu este fără eroare. Probabil ai observat deja că calitatea ieșirilor variază. Dacă simți că rezultatele nu sunt satisfăcătoare, îți permiți să fii critic.

Acceptarea ieșirilor eronate

De multe ori, rezultatele de la Google Bard nu pot fi corecte sau chiar complet greșite. S-ar putea să te fi confruntat deja cu asta în propriile tale experiențe din acest curs. Este de o importanță majoră să înțelegi că ieșirea de la Bard nu este întotdeauna fiabilă.

Întrebarea distribuirii de informații

Dacă ai informații provenite de la Google Bard, ar trebui să le verifici întotdeauna înainte de a le distribui. Ești responsabil să te asiguri că informațiile sunt corecte. Dacă nu ești sigur, apelează la surse suplimentare înainte de a distribui ceva.

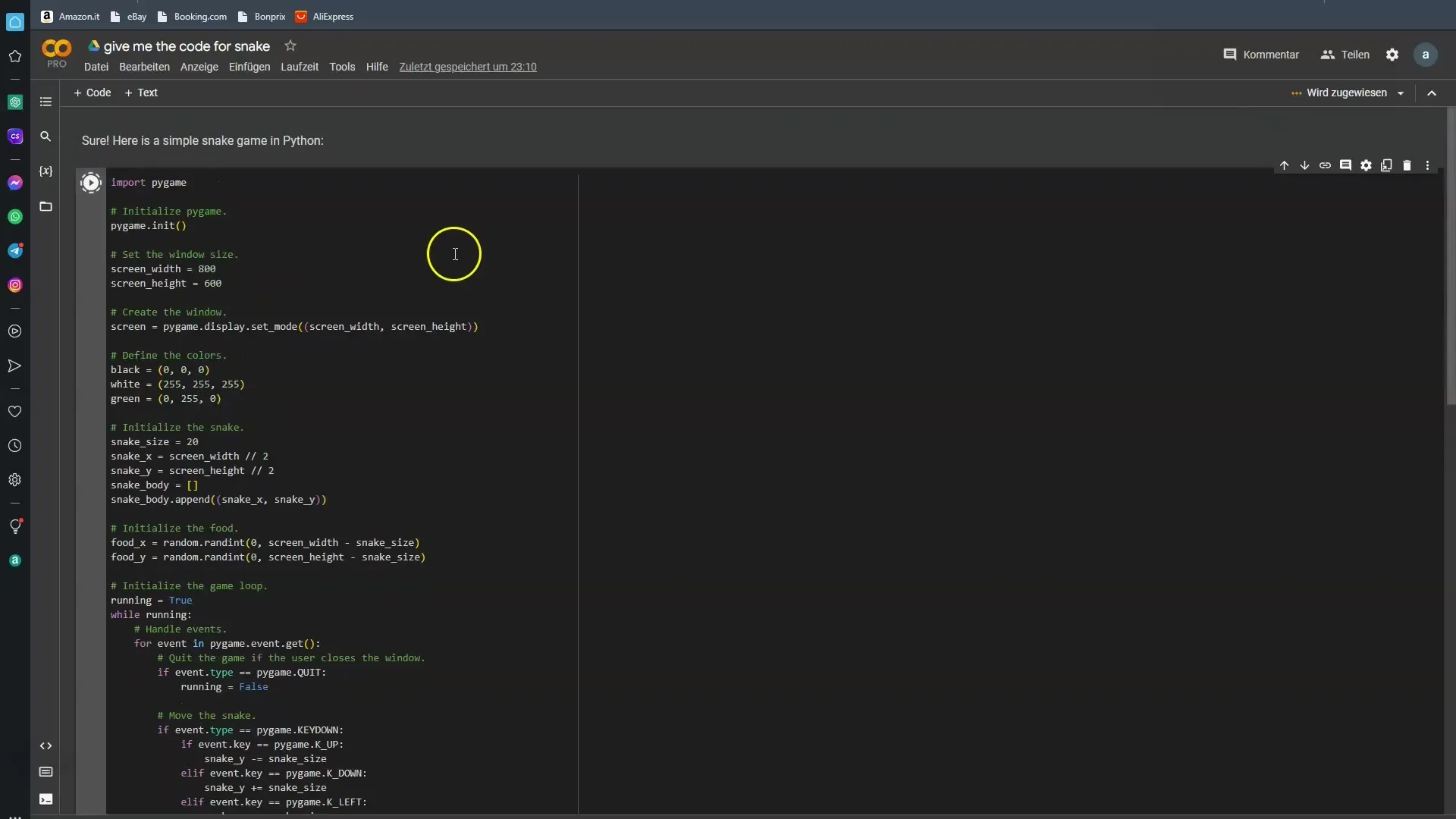

Analiza exemplificărilor de erori

Pentru a-ți ilustra erorile lui Google Bard, este util să analizezi exemple concrete. I-am cerut lui Bard un cod de program pentru un joc simplu cu Șarpe. În cele mai multe cazuri, Bard a eșuat. Să vedem dacă avem mai mult noroc de data aceasta.

Aplicarea practică a informațiilor

În special când ai întrebări tehnice, trebuie să fii conștient că răspunsurile de la Google Bard uneori nu se conformează așteptărilor tale. Este în regul să testezi sub diferite condiții pentru a verifica dacă primești ieșirea dorită.

Necesitatea gândirii critice

De fiecare dată când lucrezi cu rezultatele AI, este necesar să treci în modul de gândire critic. Google Bard poate prezenta multe lucruri, dar nu tot ce prezintă este corect. Modelul este antrenat să învețe dintr-o mulțime de date, dar aceste date nu sunt întotdeauna fără erori.

Îmbunătățiri viitoare în perspectivă

Se așteaptă ca modelele să fie îmbunătățite în viitor. Se speră că în timp ce tehnologia avansează, vulnerabilitatea la erori va scădea. Cu toate acestea, este important să recunoști și limitările actuale, astfel încât să le iei în considerare atunci când le utilizezi.

Sumar

Lumea asistenței și informațiilor asistate de AI este captivantă și plină de posibilități, dar are și riscuri. Google Bard și modelele similare reprezintă un pas către viitor, dar vin cu limitări. Este crucial să recunoști aceste limitări și să înveți să privești informațiile cu o perspectivă critică.

Întrebări frecvente

Care sunt principalele erori ale lui Google Bard?Principalele erori ale lui Google Bard constau în inexactitatea informațiilor furnizate.

De ce ar trebui să verific informațiile furnizate de Bard?Informațiile furnizate de Bard pot fi eronate și nu sunt întotdeauna fiabile.

Pot folosi Google Bard pentru întrebări tehnice?Da, dar ar trebui să pui sub semnul întrebării răspunsurile lui și, dacă este necesar, să consulți și alte surse.

Cine a antrenat pe Google Bard?Google Bard și modelele similare sunt antrenate de oameni, ceea ce poate duce la erori umane.

Va deveni Google Bard mai bun în viitor?Da, se așteaptă ca versiunile viitoare să fie mai puțin susceptibile la erori.