Veľké jazykové modely (LLM ), ako napríklad Google Bard, zohrávajú dôležitú úlohu pri poskytovaní informácií a podpore používateľov v rôznych oblastiach. Hoci tieto technológie poskytujú pôsobivé výsledky, majú aj svoje obmedzenia a výzvy. V tomto učebnom texte sa bližšie pozriete na obmedzenia systému Google Bard. Cieľom je rozvinúť kritické chápanie fungovania takýchto modelov, aby ste mohli lepšie vyhodnotiť a v prípade potreby dôkladne skontrolovať poskytované informácie.

Kľúčové zistenia

- Google Bard a podobné modely nie sú dokonalé a majú chyby.

- Výstupy môžu byť obsahovo nesprávne, aj keď vyzerajú presvedčivo.

- Pred šírením informácií musíte byť vždy kritickí a informácie si overiť.

Sprievodca krok za krokom

Pochopenie chybovosti

Je dôležité uvedomiť si, že Google Bard, podobne ako mnohé iné hlavné jazykové modely, nie je bezchybný. Pravdepodobne ste si už všimli, že kvalita výstupov sa líši. Ak máte pocit, že výsledky nie sú uspokojivé, dovoľte si byť kritickí.

Prijmite nesprávne výstupy

Výsledky z Google Bard môžu byť často nesprávne alebo dokonca úplne chybné. Možno ste sa s tým už stretli pri svojich vlastných skúsenostiach v tomto kurze. Je veľmi dôležité, aby ste pochopili, že výstupy programu Bard nie sú vždy spoľahlivé.

Spochybňovanie šírenia informácií

Ak máte informácie, ktoré pochádzajú zo služby Google Bard, mali by ste si ich pred šírením vždy overiť. Ste zodpovední za to, že informácie sú správne. Ak si nie ste istí, pred zdieľaním čohokoľvek sa poraďte s ďalšími zdrojmi.

Analyzujte príklady chýb

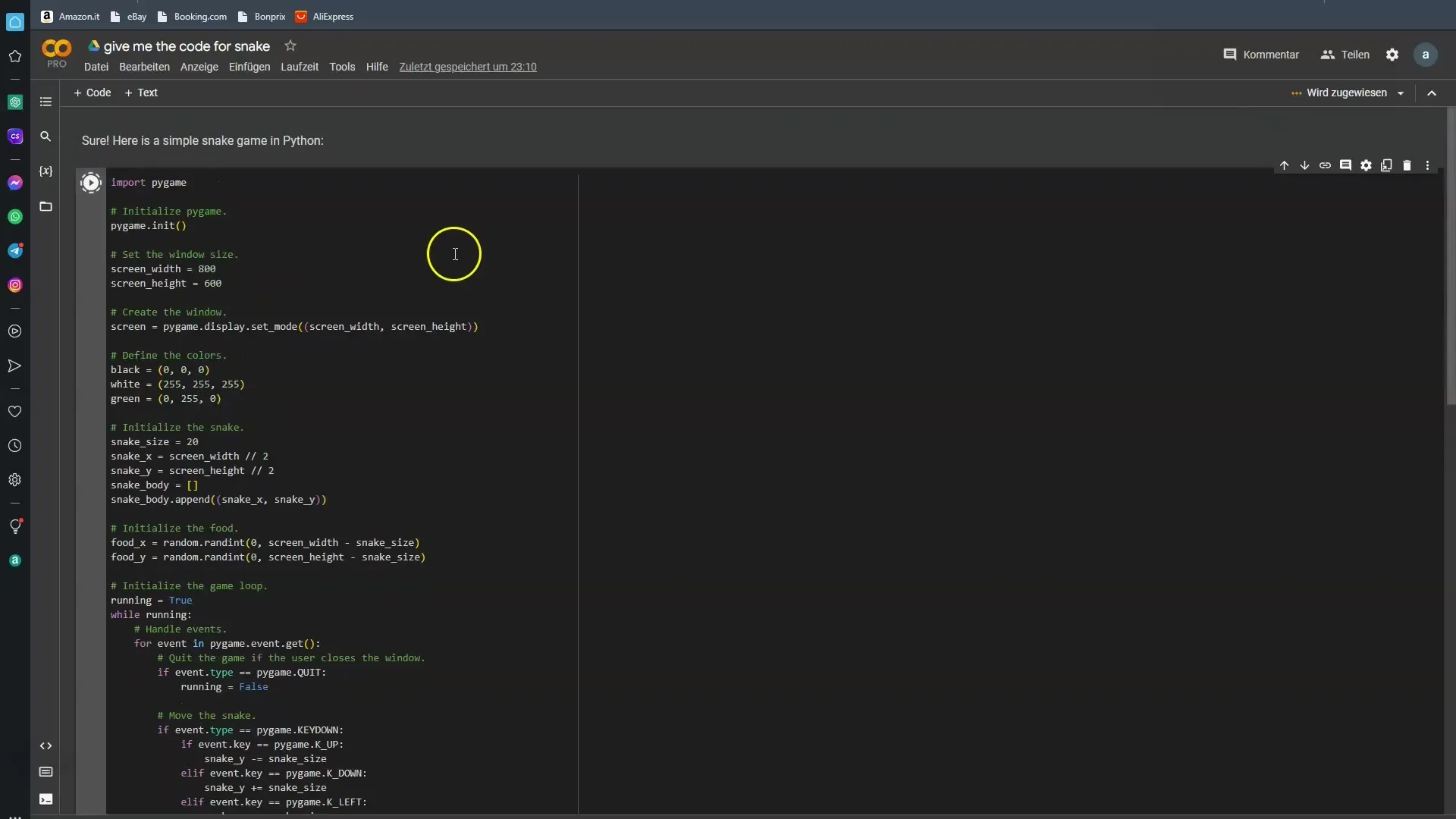

Aby ste si ľahšie predstavili, aké chyby obsahuje služba Google Bard, je užitočné pozrieť sa na konkrétne príklady. Požiadal som program Bard o kód pre jednoduchú hru s hadom. Vo väčšine prípadov Bard zlyhal. Uvidíme, či budeme mať tentoraz viac šťastia.

Praktické využitie informácií

Najmä ak máte technické otázky, mali by ste si uvedomiť, že odpovede od Google Bard niekedy nespĺňajú vaše očakávania. Je v poriadku, ak ho otestujete za rôznych podmienok, aby ste skontrolovali, či dostanete požadovaný výstup.

Potreba kritického myslenia

Vždy, keď pracujete s výsledkami umelej inteligencie, je potrebné prepnúť do režimu kritického myslenia. Google Bard vám môže predložiť veľa informácií, ale nie všetky sú správne. Model je vycvičený na učenie z množstva údajov, ale tieto údaje nie sú vždy bezchybné.

Budúce vylepšenia na obzore

Dá sa očakávať, že modely sa budú v budúcnosti ďalej zlepšovať. Dúfajme, že náchylnosť na chyby sa bude s rozvojom technológie znižovať. Napriek tomu si chceme uvedomiť aj súčasné obmedzenia, aby ste ich pri používaní mohli zohľadniť.

Zhrnutie

Svet pomoci a informácií podporovaných umelou inteligenciou je vzrušujúci a plný možností, ale skrýva aj riziká. Google Bard a podobné modely sú krokom do budúcnosti, ale majú svoje obmedzenia. Je veľmi dôležité, aby ste si tieto obmedzenia uvedomili a naučili sa na informácie pozerať s kritickým nadhľadom.

Často kladené otázky

Aké sú hlavné nedostatky systému Google Bard? Hlavnými nedostatkami systému Google Bard sú nepresnosť poskytovaných informácií.

Prečo by som mal kontrolovať informácie poskytované službou Bard? Informácie poskytované službou Bard môžu byť nepresné a nie vždy spoľahlivé.

Môžem používať službu Google Bard na technické otázky?Áno, ale mali by ste si dôkladne skontrolovať odpovede a v prípade potreby sa obrátiť na iné zdroje.

Kto vycvičil Google Bard? Google Bard a podobné modely sú vycvičené ľuďmi, čo môže viesť k ľudským chybám.

Bude Google Bard v budúcnosti lepší?Áno, očakáva sa, že budúce verzie budú menej náchylné na chyby.