Stora språkmodeller (LLM) som Google Bard spelar en betydande roll i informationsspridning och stöd till användare inom olika områden. Även om dessa teknologier levererar imponerande resultat har de också sina begränsningar och utmaningar. I denna självstudie kommer du att undersöka närmare begränsningarna med Google Bard. Målet är att utveckla en kritisk förståelse för hur sådana modeller fungerar, så att du bättre kan bedöma den tillhandahållna informationen och vid behov ifrågasätta den.

Viktigaste insikter

- Google Bard och liknande modeller är inte perfekta och har fel.

- Utmatningen kan vara innehållsmässigt felaktig trots att den verkar övertygande.

- Du måste alltid vara kritisk och verifiera informationen innan du sprider den.

Steg-för-steg-guide

Förståelse för felmarginal

Det är viktigt att förstå att Google Bard, liksom många andra stora språkmodeller, inte är felfria. Du har förmodligen redan märkt att kvaliteten på utmatningen varierar. Om du inte är nöjd med resultaten ska du tillåta dig att vara kritisk.

Acceptera felaktiga utmatningar

Ofta kan resultaten från Google Bard vara felaktiga eller rentav helt felaktiga. Detta kan du redan ha stött på under dina egna erfarenheter i denna kurs. Det är av stor vikt att du förstår att Bard:s utmatning inte alltid är pålitlig.

Granska spridningen av information

Om du har information från Google Bard bör du alltid verifiera den innan du sprider den. Du har ansvaret för att informationen är korrekt. Om du är osäker, ta hjälp av ytterligare källor innan du delar något.

Analys av fel exempel

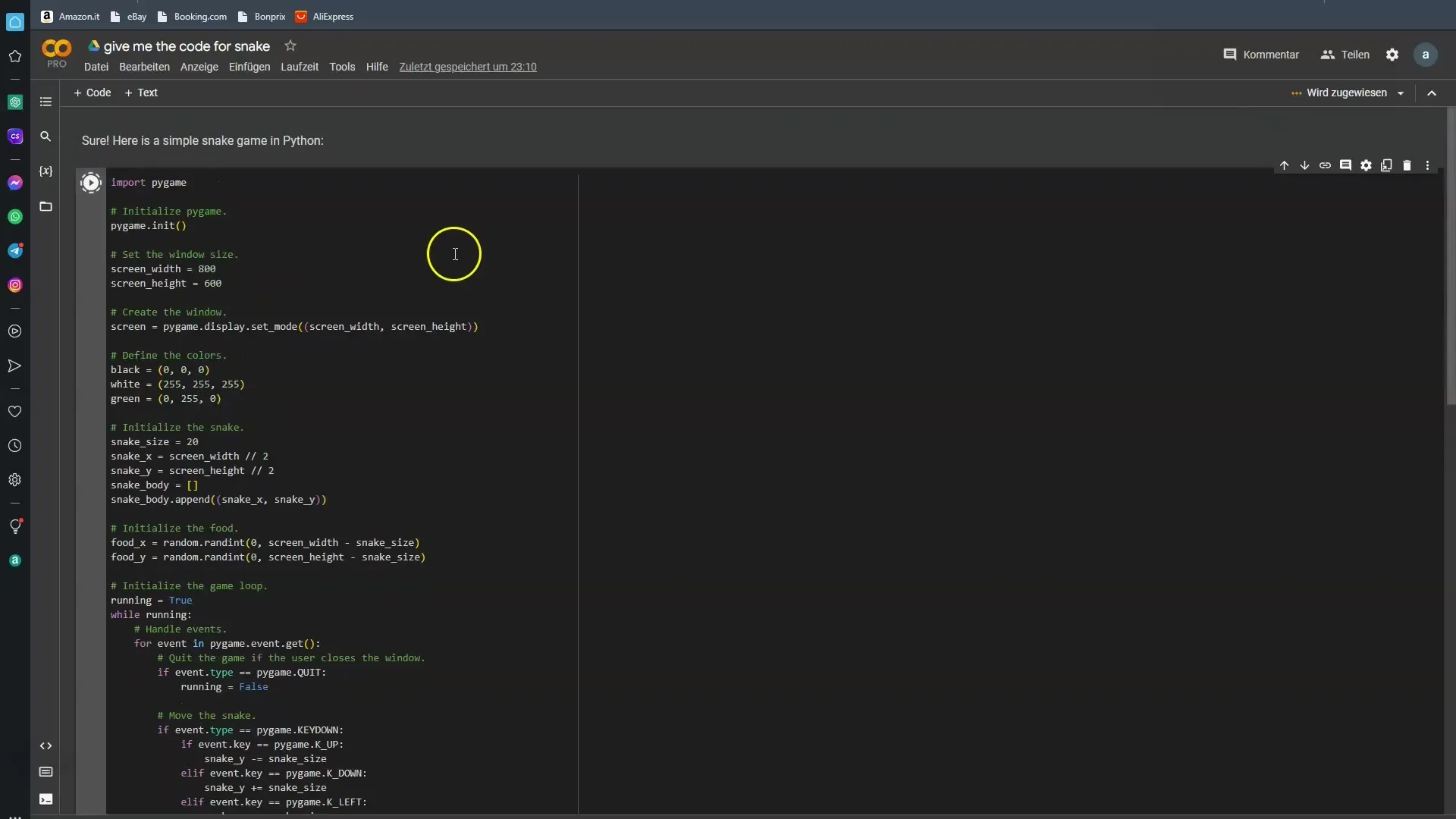

För att illustrera felaktigheterna med Google Bard är det användbart att titta på konkreta exempel. Jag bad Bard om ett programkod för ett enkelt Snakespel. I de flesta fall misslyckades Bard. Låt oss se om vi har mer tur den här gången.

Praktisk tillämpning av informationen

Särskilt när det gäller tekniska frågor bör du vara medveten om att svaren från Google Bard ibland inte motsvarar dina förväntningar. Det är okej att testa det under olika förhållanden för att se om du får önskad utmatning.

Nödvändigheten av kritiskt tänkande

Varje gång du arbetar med AI-resultat är det nödvändigt att byta till kritiskt tänkande läge. Google Bard kan presentera mycket för dig, men inte allt är korrekt. Modellen är tränad för att lära sig från många data, men dessa data är inte alltid felfria.

Framtida förbättringar i sikte

Det förväntas att modellerna kommer att fortsätta att förbättras i framtiden. Felkänsligheten kommer förhoppningsvis att minska med förbättrad teknik. Ändå är det viktigt att erkänna de nuvarande begränsningarna så att du kan beakta dem vid användning.

Sammanfattning

Världen av AI-stödd assistans och information är spännande och full av möjligheter men har också risker. Google Bard och liknande modeller är ett steg mot framtiden, men medför också begränsningar. Det är avgörande att du erkänner dessa begränsningar och lär dig att betrakta informationen med en kritisk synvinkel.

Vanliga frågor

Vad är de huvudsakliga felen med Google Bard?De huvudsakliga felen med Google Bard ligger i oegentligheten hos den tillhandahållna informationen.

Varför bör jag verifiera den information som Bard tillhandahåller?Den information som Bard tillhandahåller kan vara felaktig och är inte alltid pålitlig.

Kan jag använda Google Bard för tekniska frågor?Ja, men du bör kritiskt granska svaren och vid behov ta hjälp av andra källor.

Vem har tränat Google Bard?Google Bard och liknande modeller tränas av människor, vilket kan leda till mänskliga fel.

Kommer Google Bard att bli bättre i framtiden?Ja, förväntas det att framtida versioner kommer att vara mindre felbenägna.